――今回、HTBでは生成AIを活用して、放送された番組から記事を生成する仕組みの独自開発に取り組まれたとのことですが、どのようなシステムなのでしょうか?

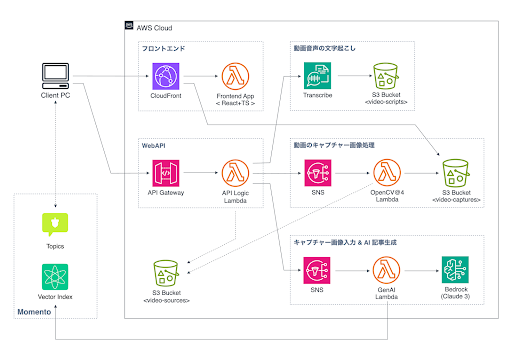

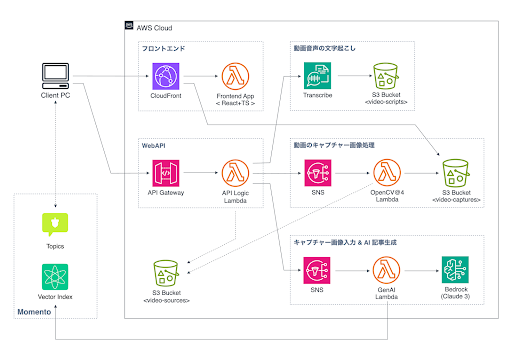

三浦 3分から5分程度の短い動画を元に自動的に記事を生成するもので、1)動画のアップロード、2)音声認識、3)画像の切り出し、4)画像のキャプションを生成、5)記事を生成、という5つのステップを経て、画像が入ったブログ記事をある程度、自動的に作るというものです。

この5ステップは、別々のアプリケーションになっていて、現在はそれぞれ出てきたデータと、生成AIへの指示となるプロンプトを手動で入力する必要があります。すべてをAWS上で構築しており、それぞれをAPIでつなぐ事は簡単にできるので、完全な自動化もすぐに可能です。

HTBの三浦さん

HTBの三浦さんこの取り組みをスタートした当初は、ターミナルからコマンドラインで入力していましたが、現在のような構成に落ち着いてきてからは、社内でいろんな方に試していただけるように、WebのUIを作りました。

――テレビ局が、生成AIを使って記事作成の自動化に取り組んだのには、どのような事情があるのでしょうか。

高瀬 私と三浦が所属するネットデジタル事業部では、これまでVODサービスやECなどで、クラウドを使ったサービス作りに取り組んできました。開発そのものは三浦が担当して、私の方は社内調整や売り上げ管理といった、開発と運用の中間の立場でした。

それと並行して、HTBのウェブサイトやウェブメディアの運用については、実務も担当もしています。「SODANE」という、番組の紹介や放送内容についての詳細な情報、料理のレシピなどを載せているウェブメディアで、年間に1000本くらいの記事を公開しています。

そこで載せる原稿は、3割くらいは番組担当者などが書いたものを載せているのですが、残りの7割くらいは、私ともう1人の担当者の2人で執筆から掲載まで行っています。このウェブメディアに関する業務量がかなりのウェイトになっています。

HTBのオウンドメディア「SODANE」

HTBのオウンドメディア「SODANE」三浦 テレビの情報番組で紹介した内容が、一度だけ放送して終わってしまうのはもったいない、という議論は以前から社内でありました。そこでオウンドメディアを立ち上げようということになり、最初は番組紹介から始まって、現在では情報番組のなかのコーナー、ニュース番組で放映した5分から10分くらいの特集をもとに記事を作って載せています。

高瀬さんと、もう一人の担当の方が、「今週はあと10本書くぞ」と頑張っているのを見ていて、そこを何とか楽にしてあげることができないかと考えたのが、今回のきっかけです。

――管理職が執筆からCMSへの入稿まで、すべて行っているというのは、かなり大変そうですね。

高瀬 専属ライターがいないので、気合いと根性でやってきました(笑)。実は、来月から私が異動することになったんです。後任は、私より筆が立つ人間なので、執筆スピードや本数については心配していません。ただ、今後もそういった人間が配属されるとは限らないので、誰が担当になってもスピードや本数を落とさないようにしたいと考えました。

三浦 独自に取材して、ゼロから書くような記事は、人間にしかできません。ただ、私たちのオウンドメディアは、テレビ番組を元にしている記事が多いので、記事を作るときは、まず動画を見るところから始めます。そこからコメントなどを書き起こして、記事に入れる画像のスクリーンショットを撮って、文章にまとめるという流れになります。

そうやって高瀬さんたちが頑張って5年にわたって更新を続けてきた結果、「SODANE」のメディアとしての価値が上がって来ました。他の営業案件やイベント企画などでも「SODANEに記事を載せる」ということがプラスに働くケースが増えてきたんです。

その結果、今後は「SODANE」単体で広告費をいただくことも、現実的な話になってきました。それもあって、少数の担当者が頑張るだけではなくて、仕組みとしてスピードと本数を維持できるようにしないといけないと考えました。記事の本数と更新頻度は、メディアの価値そのものに直結してしまうので、そこを落とすことはできないですから。

――だから、生成AIを活用した記事作成システムの開発が本格的にスタートしたんですね。

三浦 この1~2年、我々の開発チームが取り組んで来た動画配信とECの開発が一段落しました。もちろん、日々の運用、細かな改善や機能追加はあるのですが、少しは余裕ができました。そこで、新たな形で社内で貢献できるような開発をできないかと考えたんです。

サーバーレスオペレーションズには、以前から内製化支援をしていただいていて、金さんにはいつもいろんな相談をしていました。そうしたなかで「生成AIを使って、何かやらないんですか?」と言われたところから、今回のプロジェクトがスタートしました。

以前から、生成AIについてはいろいろと試してはいました。Amazon Bedrockが始まってすぐの頃に、高瀬さんが過去に書いた記事を使って、検索拡張生成(RAG)に挑戦したのですが、想像以上に手間が掛かるため、途中で止めてしまいました。

しかし、高瀬さんの異動が決まったため、改めてサーバーレスオペレーションズに相談したところ、動画を元に記事を生成するアイデアが出てきて、PoCをスタートさせました。

金 最初にアイデアをうかがったのが、2023年の年末頃でした。そこからPoCの構成を考えて、3月頃に動くものができました。当初は、先ほど三浦さんがおっしゃったように、ターミナルからコマンドラインで使う形でした。それを三浦さんや高瀬さん、他のHTBの社員の方に使っていただき、フィードバックを元に構成を変えたり、WebのUIを作ったりして、今のような形になりました。

記事自動生成システムの構成

記事自動生成システムの構成――動画を元に文字起こしや、それを要約をするというのは生成AIの利用事例としてよく見かけますが、スクリーンショットも使った記事の作成というのは、かなり踏み込んだ取り組みです。

三浦 一番最初の検証では、4~5分の料理コーナーをやったのですが、そんなに悪くないという印象でした。もちろん、「てにをは」や名詞の間違いはあったのですが、料理の手順が伝わる文章にはなっていたんですね。これなら、何とかなりそうだ、と思いました。

もちろん、不十分なところもあって、20分くらいの北海道の観光地を紹介する番組で試した場合は、サマリーとして不十分なものになりました。まったく的外れな所をピックアップして要約していたんです。

そうやって試していくことで、生成AIの得意・不得意が見えてきました。現時点でも5分程度の短い映像なら、人間が修正することを前提にして、省力化の為の取り組みなら十分に意味があると判断して、進めることにしました。

番組によっては4~5分のコーナーを毎日やっているものもあるので、映像が完成したらそれを受け取って、生成AIに入力したら下書きが出来ている。人間はそれをチェック、修正して公開するだけ、という運用が実現すれば、かなりの省力化になります。

高瀬 最初は、いったいどんなことができるのかまったくわかりませんでした。そこから、PoCが始まった段階で、20分くらいの映像から、1分くらいの短いものなど、いろんなパターンの映像を試しました。

登場人物がひとりで料理をするもの、複数人が自由に話しているものなど、AIにとってどれが得意で、どれが不得意なのか、一緒に絞り込みました。その結果、3分くらいで、登場人物が少ないものなら、かなりの精度でできると確信するところまできました。

もちろん、固有名詞などの苦手なところはあるのですが、あらかじめそうした傾向がわかっていれば、修正の段階で元の資料からコピー&ペーストするなどすれば、全体では効率が上がっていることを体感できました。

それに、テレビ局のアナウンサーやプロのナレーターは発音がしっかりしているので、そういった方が登場している番組は音声認識の精度が高いので、こうした取り組みには適していると感じました。

――生成AIの現段階での能力を見極めて、得意なところを現実のワークフローに適用するという、工夫が今回のポイントなんですね。他に工夫したところはありますか?

金 システムとして工夫したのは、記事内の番組のスクリーンショットを撮って、記事の段落ごとに入れ込むところです。動画をそのままLLMに入力して、テキストにあったスクリーンショットを撮らせるのは、現時点では難しいです。

そこで、動画から一定の秒数ごとにスクリーンショットを撮り、その画像に対して生成AIでキャプションを付け、別に生成した本文テキストにあったスクリーンショットを、キャプションに基づいてAIが選んでいます。また、キャプションを付けるLLMとして、Anthlopicの「Claude 3」の3つあるモデルのうち、Haikuという最も軽いモデルを使うことで、元の動画の長さと同じくらいの時間で処理できました。

ちなみに、LLMはAmazon Bedrockを経由して、Anthropicの「Claude 3」を主に使っています。記事の本文テキストの生成にはOpusを、画像のキャプションを生成するところは同じくHaikuで、そこから本文に沿った画像を選ぶところもOpusです。

あと、これまでのHTBさんの開発と同様に、今回も100パーセント、サーバーレスにこだわって開発しています。

三浦 生成AIについては、まだ資料や先行事例が少なくて、コーディングについてはかなり金さんに頼り切りでした。それに、これまでの開発は、金さんに相談して2~3回のやりとりで形になることが多かったですが、今回は何回やりとりしたのかわからないほどです。その結果、現在のUI画面は、当初の想定とはまったく違うものになっています。

こうした新しい分野についても、サーバーレスオペレーションズに相談すると、最新の情報を把握した上で、整理して選択肢として提示してくれるので、無事にゴールへたどり着きました。この後は、できるだけ我々のチームのなかで開発を継続していきたいです。

――他に、生成AIを使った開発について、気になったことなどはありますか?

三浦 生成AIはどんどん新しいサービスやモデルが登場するので、今回の仕組みもモデルを自由に切り替えられるようになっています。Amazon Bedrock経由で、Claude 3が使えるようになって、すぐに試してみたんですが、以前よりも性能が上がっていて驚きました。

これだけ進化のスピードが速いと、特定のモデルに依存したシステムだと、すぐに使えなくなってしまいます。だから、モデルは入れ替える前提で考えないといけないということがよくわかりました。

高瀬 開発当初と比べると、最新のバージョンはClaude 3を使っているので、文章自体もタイトルの付け方も、違和感がなくなっています。AIの進歩が目に見えてわかるのに驚かされました。そろそろ本番に投入しても問題なさそうなので、来月の異動までに何本か生成AIによる記事を掲載する予定です。